L’impatto dell’IA sulla sanità e le questioni etiche

L’impatto dell’applicazione delle tecnologie di Intelligenza Artificiale (IA) e di Machine Learning (ML) sulla sanità è talmente decisivo che oggi non esiste ambito della medicina e dell’erogazione delle cure che non sia stato trasformato da tecnologie e programmi basati sull’IA (1, 2). Tuttavia, come per ogni altro ambito tecnologico, anche l’uso dell’IA e del ML in sanità solleva questioni etiche, giuridiche e sociali (ESL) in diversi ambiti: dalla tutela dei pazienti, alla questione dell’affidabilità dei dati e dell’IA nelle applicazioni di medicina predittiva, fino al rapporto tra medici, operatori sanitari, pazienti e IA (3).

Privacy, consenso e responsabilità dei professionisti

Le questioni etiche riguardano l’applicazione del GDPR europeo e di qualsiasi altra normativa internazionale a tutela della privacy dei pazienti, della riservatezza e dell’integrità dei dati personali; l’efficacia del consenso informato; il benessere umano nell’uso delle tecnologie e dei programmi sanitari basati su IA; e la conseguente necessità di un’adeguata formazione all’uso di tecnologie spesso poco familiari alle persone. L’IA impiegata nella sanità deve essere affidabile, trasparente e degna di fiducia. I dati utilizzati per la costruzione dei modelli e per l’addestramento dell’IA devono essere sicuri e privi di bias. Il rapporto tra professionisti della salute, tecnologie digitali e strumenti di IA deve essere valutato con attenzione, al fine di evitare la creazione di modelli gerarchici distorti e di mantenere nei professionisti sanitari la responsabilità decisionale ultima (4).

La metodologia del progetto PRAESIIDIUM

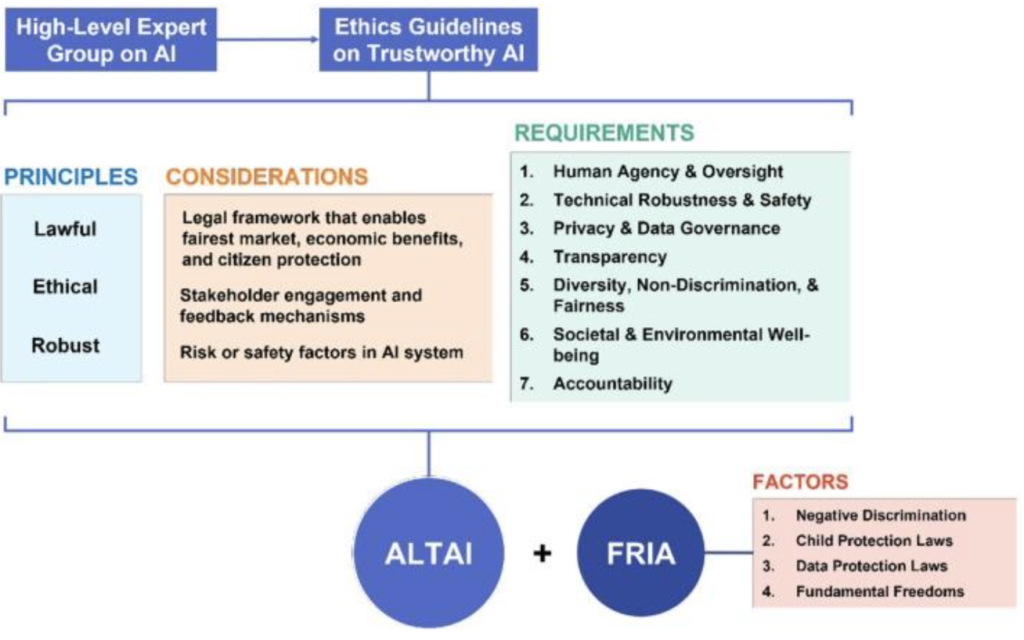

Presentiamo qui la metodologia adottata dal consorzio del progetto PRAESIIDIUM di Horizon Europe, in cui modelli matematici multi-scala e tecniche di IA spiegabile (eXplainable AI) sono utilizzati per prevedere il rischio individuale di prediabete in modo personalizzato. Dati reali su larga scala, provenienti da studi clinici retrospettivi e prospettici, inclusi dispositivi indossabili, vengono impiegati per addestrare gli algoritmi. Per valutare le questioni ESL emergenti dalle attività del progetto, PRAESIIDIUM ha adottato una metodologia Ethics by Design (EbD, 5) applicando le procedure raccomandate da ALTAI, Assessment List for Trustworthy Artificial Intelligence, la procedura di valutazione raccomandata dall’High-Level Expert Group on Artificial Intelligence (AI HLEG) su richiesta della Commissione Europea (6, 7).

ALTAI: strumento di autovalutazione etica

ALTAI è uno strumento di autovalutazione dell’affidabilità dei sistemi di IA utilizzati nei progetti europei. Si basa sulla tutela dei diritti fondamentali delle persone, secondo i Trattati dell’UE, la Carta dei Diritti Fondamentali (la Carta) e il diritto internazionale dei diritti umani (8, 9).

Confronto con altri metodi di valutazione

Rispetto ad altri metodi di valutazione dell’affidabilità dell’IA come gli standard ISO/IEC, in particolare lo standard ISO/IEC 42001 (10) progettato per i sistemi di gestione dell’IA; la metodologia IEEE presentata nel documento Ethically Aligned Design: A Vision for Prioritizing Human Well-being with Autonomous and Intelligent Systems (A/IS) elaborata dai comitati dell’IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems (11); e le procedure di valutazione del rischio per l’industria come la Safety Of The Intended Functionality, SOTIF (12), ALTAI si propone di unire in un’unica metodologia di autovalutazione completa le principali questioni etiche che possono emergere dall’uso di IA e ML, adatta per applicazioni sanitarie, ricerca e industria.

Procedura e autovalutazione etica condivisa

ALTAI individua le questioni etiche valutando l’applicazione dell’Intelligenza Artificiale alla luce della protezione dei diritti umani definiti nei Trattati dell’Unione Europea, nella Carta dei Diritti Fondamentali (la Carta) e nel diritto internazionale sui diritti umani (8,9). Propone inoltre una procedura articolata di autovalutazione, misure di mitigazione e il coinvolgimento precoce di tutti i partner del consorzio – attraverso incontri partecipativi e tecniche di sondaggio – per produrre ogni anno, per tutta la durata del progetto, una Autovalutazione Etica Condivisa. Questo approccio mira a garantire il rispetto dei diritti umani nella pratica clinica, un’omogeneizzazione delle procedure e a prevenire problemi tipici dei progetti multidisciplinari.

Ruoli dei partner nel progetto

Il partner responsabile per l’Ethics Self-Assessment (ESA) è la Scuola di Robotica Italiana, mentre il coordinatore Spindox ricopre il ruolo di Data Protection Officer ed è responsabile del Data Management Plan. Entrambi hanno collaborato con il consorzio per produrre la documentazione preparatoria per l’ESA nelle varie versioni, una per ciascun anno del progetto. Tutti i partner hanno collaborato non solo sulle questioni etiche specifiche delle proprie attività, ma hanno anche contribuito alle discussioni riguardanti ambiti non direttamente connessi al loro lavoro.

Privacy e rappresentatività nei trial clinici

Nel progetto PRAESIIDIUM, le questioni relative al rispetto e alla protezione della privacy dei partecipanti agli studi clinici condotti presso i Centri Medici in Lettonia e Austria sono state valutate dai rispettivi Comitati Etici. Ciò ha garantito che la selezione dei volontari fosse libera da bias o da stigmatizzazione di gruppi sociali specifici, rispettasse l’equilibrio di genere e assicurasse la riservatezza dei partecipanti. Allo stesso modo, si è verificato che i dati raccolti rappresentassero culture diverse, nonché differenti abitudini alimentari e stili di vita.

Algoritmi, dataset e raccomandazioni personalizzate

Le questioni etiche legate all’uso dei modelli di IA, alla validazione dei modelli e alla relazione tra clinici e strumenti digitali e di IA sono state anch’esse valutate mediante lo strumento ALTAI.

Il progetto sta producendo dataset derivanti da sensori indossabili, dati clinici retrospettivi e prospettici, e gli algoritmi di intelligenza artificiale e i modelli matematici vengono addestrati su questi dataset per definire raccomandazioni personalizzate per la riduzione del rischio, ad esempio attraverso dieta o attività fisica. L’algoritmo di caratterizzazione e riduzione del rischio sarà implementato tramite una piattaforma web, nella quale sia i pazienti sia i medici potranno inserire dati provenienti da diverse fonti, in modo da stimare il rischio in tempo reale e attuare interventi personalizzati per la sua riduzione.

La complessità delle valutazioni etiche

Per l’analisi delle questioni Etiche, Legali e Sociali (ESL), sono coinvolti due ambiti: la medicina clinica e l’IA applicata alla salute. Per questo motivo, la valutazione etica presenta una complessità relativa maggiore rispetto ad altri progetti sanitari o di ricerca sull’IA, poiché coinvolge due settori che fino a qualche decennio fa erano relativamente distanti: le questioni etiche nella ricerca e innovazione medica e quelle legate allo sviluppo dell’IA e dei dispositivi di salute digitale per applicazioni umane.

Ethics Board e Ethics Roadmap

Il consorzio ha cercato di ridurre le differenze di approccio tra i clinici e gli esperti di IA coinvolgendo i primi nella ricerca sui modelli e i secondi nel comprendere le relazioni complesse tra medici, clinici e pazienti, in merito alla diagnosi e al trattamento, nonché al rapporto che i professionisti della salute hanno con le tecnologie digitali e l’intelligenza artificiale.

Il primo passo è stato istituire un Ethics Board del progetto, al quale hanno partecipato tutti i partner del consorzio, e creare una Ethics Roadmap che identificasse, sulla base della metodologia Ethics by Design, del GDPR e delle linee guida europee sull’uso etico dell’IA, le principali questioni relative all’utilizzo di dati reali, retrospettivi e prospettici; le linee guida per ottenere un’IA basata su Machine Learning affidabile (Trustworthy ML AI); e le questioni legate a privacy, benessere e usabilità dei dispositivi e sensori indossabili per la raccolta dei dati.

Requisiti etici del progetto PRAESIIDIUM

Nella redazione della Ethics Roadmap sono stati considerati i seguenti requisiti delineati nel DoA (Description of Action) del progetto PRAESIIDIUM:

M1) Come garantire la riproducibilità di un sistema predittivo basato sui dati?

M2) Come migliorare l’interpretabilità e l’affidabilità delle soluzioni di Machine Learning (ML)?

M3) Come aumentare l’accuratezza nella previsione del rischio riducendo al contempo i tempi di calcolo?

M4) Come integrare attributi dei dati come completezza, equità, requisiti di qualità in un sistema di diagnosi assistita da computer (Computer Aided Diagnosis, CAD)?

M5) Come garantire che il disegno generale del progetto sia conforme ai requisiti etici sin dall’inizio?

M6) Come garantire che le indagini cliniche siano progettate nel rispetto di tutti i requisiti etici e sociali?

Le sette categorie etiche di ALTAI

Ciascuno di questi requisiti esprime diverse problematiche etiche, legali e sociali (ELS), che possono essere esplicite o implicite, e sono state identificate studiando le conseguenze derivanti dalle risposte a queste domande. Per esempio, la risposta sviluppata dal progetto alla domanda/requisito – apparentemente solo tecnico – Come aumentare l’accuratezza nella previsione del rischio riducendo i tempi di calcolo?, comporta in realtà importanti ricadute etiche: variazioni nei parametri di sostenibilità, benessere, valutazione del rischio, incidenza di falsi positivi/negativi, accuratezza della medicina predittiva e nella complessa relazione medico-paziente.

Nella Ethics Roadmap di PRAESIIDIUM, i requisiti sopra elencati sono stati tradotti nell’analisi etica delle sette macro-categorie di ALTAI, che corrispondono ai diritti fondamentali delle persone da rispettare e tutelare, e ai requisiti necessari per sviluppare e impiegare un’IA affidabile (Trustworthy AI).

Queste categorie sono:

-

azione e supervisione umana

-

robustezza tecnica e sicurezza

-

privacy e governance dei dati

-

trasparenza

-

diversità, non discriminazione ed equità

-

benessere ambientale e sociale

-

responsabilità (accountability)

Supervisione umana e autonomia decisionale

Se consideriamo le categorie e i requisiti di ALTAI rispetto ai requisiti etici del progetto, la domanda, ad esempio, Come aumentare l’accuratezza nella previsione del rischio riducendo i tempi di calcolo? corrisponde ai requisiti di robustezza tecnica e sicurezza, e di benessere ambientale e sociale.

La categoria azione e supervisione umana comporta analisi etiche su più livelli, tra cui la gerarchia di controllo dell’IA da parte degli operatori umani e dei pazienti, in modo da garantire che l’essere umano sia sempre in una posizione di supervisione attiva (on-the-loop); che la responsabilità ultima degli effetti dell’IA sia sempre attribuibile a un essere umano; e che trasparenza e spiegabilità dell’IA siano garantite in modo da assicurare l’human agency, ovvero il controllo e il potere decisionale finale sull’uso dei sistemi di IA.

I sistemi di IA dovrebbero sostenere l’azione e il processo decisionale umano, come previsto dal principio del rispetto per l’autonomia umana. Questo richiede che i sistemi di IA agiscano come abilitatori per una società democratica, fiorente ed equa, supportando l’autonomia dell’utente; e che tutelino i diritti fondamentali, che dovrebbero essere garantiti dalla supervisione umana. In questa sezione i sistemi di IA vengono valutati in base al rispetto dell’autonomia e dell’azione umana, nonché alla supervisione da parte dell’uomo. (ALTAI, cit., p. 7, 13)

Ethics Survey e affidabilità dei modelli

Sulla base della Ethics Roadmap, è stata proposta al consorzio una serie di domande (Ethics Survey) volte a stimolare riflessioni sia generali che specifiche sui requisiti etici che informano tutte le attività del progetto. La Scuola di Robotica (SdR) ha condotto incontri da remoto e in presenza con i singoli partner per chiarire lo scopo e la direzione delle domande e applicare con precisione la metodologia ALTAI. Una categoria particolarmente rilevante per il progetto è quella della affidabilità dei modelli e del Machine Learning, in relazione ai problemi che possono emergere e che possono sollevare questioni etiche.

Dichiarazioni di consenso etico, focus group e prospettive future

SdR ha analizzato e raccolto le risposte dei partner al questionario in un documento che rappresenta la Dichiarazione di Consenso del Consorzio in materia di Etica.

Sono in fase di organizzazione due focus group con l’obiettivo di raccogliere le opinioni dei partecipanti agli studi clinici: anche questo strumento contribuirà a perfezionare l’uso degli strumenti digitali e di IA nella pratica clinica e a comprendere come i partecipanti abbiano percepito la loro utilità e i benefici.

Il progetto ha completato il suo secondo anno di attività ed è in corso il processo di produzione della seconda Dichiarazione di Consenso Etico. Al termine del terzo anno, sarà redatta una Dichiarazione Finale di Consenso Etico, che proporrà alla Commissione Europea, come buona pratica, la procedura articolata e completa adottata da PRAESIIDIUM per la valutazione delle questioni etiche.

Articolo di Fiorella Operto, Gianmarco Veruggio, School of Robotics

References

- Alowais, S.A., Alghamdi, S.S., Alsuhebany, N. et al. Revolutionizing healthcare: the role of artificial intelligence in clinical practice. BMC Med Educ 23, 689 (2023). https://doi.org/10.1186/s12909-023-04698-z

- Bajwa J, Munir U, Nori A, Williams B. Artificial intelligence in healthcare: transforming the practice of medicine. Future Healthc J. 2021 Jul;8(2):e188-e194. doi: 10.7861/fhj.2021-0095. PMID: 34286183; PMCID: PMC8285156

- 3. Danton S. Char, Nigam H. Shah, and David Magnus. 2018. Implementing Machine Learning in Health Care – Addressing Ethical Challenges. Engl. J. Med. 378, 11 (March 2018), 981–983. https://doi.org/10.1056/NEJMp1714229

- Kelley JM, Kraft-Todd G, Schapira L, Kossowsky J, Riess H. The influence of the patient-clinician relationship on healthcare outcomes: asystematic review and meta-analysis of randomized controlled trials. PLoS One. 2014;9(4):e94207.

- Ethics By Design and Ethics of Use Approaches for Artificial Intelligence, the European Commission, DG Research & Innovation RTD.03.001- Research Ethics and Integrity Sector, 25/11/2021), https://ec.europa.eu/info/funding-tenders/opportunities/docs/2021-2027/horizon/guidance/ethics-by-design-and-ethics-of-use-approaches-for-artificial-intelligence_he_en.pdf

- 6. Charles Radclyffe, Mafalda Ribeiro, and Robert H. Wortham. 2023. The assessment list for trustworthy artificial intelligence: A review and recommendations. Front Artif Intell 6, (March 2023), 1020592. https://doi.org/10.3389/frai.2023.1020592

- 7. To consult ALTAI: (Assessment List for Trustworthy Artificial Intelligence

- https://ec.europa.eu/info/aid-development-cooperation-fundamental-rights/your-rights-eu/eu-charterfundamental-rights_en

- https://www.un.org/en/sections/universal-declaration/foundation-international-human-rights-law/index.html.

- ISO/IEC 42001 is an international standard that specifies requirements for establishing, implementing, maintaining, and continually improving an Artificial Intelligence Management System (AIMS) within organizations. It is designed for entities providing or utilizing AI-based products or services, ensuring responsible development and use of AI systems. https://www.iso.org/standard/81230.html

https://standards.ieee.org/wp-content/uploads/import/documents/other/ead_v2.pdf

- The IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems, (The IEEE Global Initiative), Ethically Aligned Design: A Vision for Prioritizing Human Well-being with Autonomous and Intelligent Systems (A/IS)

- https://www.iso.org/standard/70939.html

- Radclyffe, Ch., Ribeiro, M., Wortham, R.H. (2023). The assessment list for trustworthy artificial intelligence: A review and recommendations. Front. Artif. Intell. , 09 March 2023. Sec. AI in Business.

Volume 6 – 2023 | https://doi.org/10.3389/frai.2023.1020592